Als ich zwischen November 2025 und Februar 2026 die rasante Entwicklung im Agenten-Ökosystem beobachtete, erwischte mich ein Moment der Überraschung: ein offener Agent eroberte in Windeseile Entwickler-Workflows und Diskussionsforen. Ich erinnere mich, wie ich ein kleines Script testete, das über Telegram Dateien holte, Code ausführte und mir danach eine präzise To‑Do‑Liste schickte — und plötzlich war klar: Agenten sind keine Spielerei mehr. Dieses Stück skizziert, warum OpenClaw so einschlug, welche Zahlen und Daten hinter dem Hype stehen und warum ich zugleich für eine stärkere menschliche Kontrolle plädiere.

1) OpenClaw Überblick & der OpenClaw‑Moment

Wenn ich auf November 2025 bis Februar 2026 zurückblicke, sehe ich den klaren Umschwung: Weg von reiner Textausgabe, hin zu autonomen Agenten, die Aufgaben wirklich ausführen. Mein persönlicher „OpenClaw‑Moment“ war der Punkt, an dem ein offener Agent nicht mehr nur Demo im Labor war, sondern plötzlich im Alltag vieler Entwickler landete.

Ursprung: ClawdBot, Claude‑Kontext und Peter Steinberger

OpenClaw startete als ClawdBot im Umfeld von Anthropics Claude und wurde von Peter Steinberger initiiert. In der Community setzte sich schnell der Name OpenClaw durch – auch, weil das Projekt als Open-Source Software ungewöhnlich offen entwickelt wurde. Steinberger brachte es auf den Punkt:

„The claw is the law.“

„Ich will einen Agenten bauen, den sogar meine Mutter nutzen kann.“

OpenClaw Features: Handlungskraft durch Tools, Memory und Skills

Was den OpenClaw Überblick prägt, sind konkrete Fähigkeiten statt Marketing. Entscheidend waren:

- Werkzeugzugriff für echte Workflows

- sandboxed Code‑Ausführung für sichere Tests in isolierter Umgebung

- persistent Memory für langfristigen Kontext

- Agent Skills (über 100 via ClawdHub Registry)

- Anbindung an Telegram, WhatsApp, Discord

Viralität, Vibe Coders und rechtliche Zäsur

Die schnelle Verbreitung kam weniger aus „besserer KI“, sondern aus Offenheit und aktiver Community‑Interaktion – besonders auf X. Die „Vibe Coders“ bauten, teilten und remixten Agenten in Tagen, trotz realer Sicherheitsbedenken. Die Cease‑and‑Desist‑Intervention von Anthropic markierte dann die Wende. Am 17. Februar 2026 wechselte Steinberger zu OpenAI; parallel wurde eine Stiftung für OpenClaw angekündigt.

OpenClaw kostenlos: Was wirklich kostet

Wichtig für die Praxis: OpenClaw kostenlos bedeutet kein Abo und keine Lizenzgebühren. Kosten entstehen vor allem durch Hardware und genutzte APIs – nicht durch das Projekt selbst.

2) Warum Agenten jetzt handlungsfähig werden

Vom Chat zur Agenten Workforce

Wenn ich die Monate November 2025 bis Februar 2026 betrachte, sehe ich einen klaren Paradigmenwechsel: Weg von reiner Sprachverarbeitung, hin zu Systemen, die handeln. Ein AI Agent ist nicht mehr nur ein Antwortgenerator, sondern ein Worker, der Tools nutzt, Dateien bewegt, Code ausführt und Aufgaben über mehrere Schritte hinweg abschließt. Genau das war für mich der „OpenClaw-Moment“: Ein offener Agent verließ die Labore und landete im echten Entwickleralltag.

Coding Agents sind General‑Purpose‑Agents

Warum gerade Coding Agents so schnell „allgemein“ werden, ist simpel: Sie kombinieren Sprachschnittstelle, Memory und Codegenerierung – und Code ist die universelle Fernbedienung für Software. Damit gehen Agenten weit über klassische UIs hinaus und setzen neue Automatisierungsstandards, vom Debugging bis zur Prozess-Orchestrierung in Slack, Telegram oder Discord.

- Toolzugriff + sandboxed Ausführung: weniger Theorie, mehr Output

- Persistenter Speicher: Aufgaben werden über Tage „weitergedacht“

- Skills und Integrationen: Agenten werden zu Workflows, nicht zu Chats

Technikschub: größere Modelle, smartere Architektur, mehr Lokale Modelle

Die neue Handlungsfähigkeit wird auch durch Modellfortschritte getragen: Größere Modelle und Architekturtricks wie sparsames Aktivieren drücken Kosten bei hoher Leistung. Beispiel: Qwen3.5‑397B‑A17B hat 397B Parameter, aktiviert aber nur 17B pro Token. Gleichzeitig erhöhen Modelle wie Gemini 3 Pro, Qwen3‑Max (>1T), MiniMax M2.5 und GLM‑5 den Druck, während Lokale Modelle für sensible Workloads attraktiver werden.

Marktdynamik: Viralität schlägt Labor-Perfektion

Harrison Chase: „Erfolg von Projekten wie OpenClaw liegt oft weniger in der Technik als im Timing und der Community‑Interaktion.“

Ich sehe hier den Kern: Unabhängige Entwickler liefern oft das nutzernahe Killer‑Erlebnis, während große Labs nachziehen. Gleichzeitig wird Open-Source AI zum Streitpunkt, wenn Sponsoren, Stiftungsmodelle und Geschäftsinteressen aufeinanderprallen.

Sam Altman: „Wir wollen die nächste Generation personalisierter Agents bauen.“

3) Kosten, Hosting & Wirtschaftlichkeit (konkrete Zahlen)

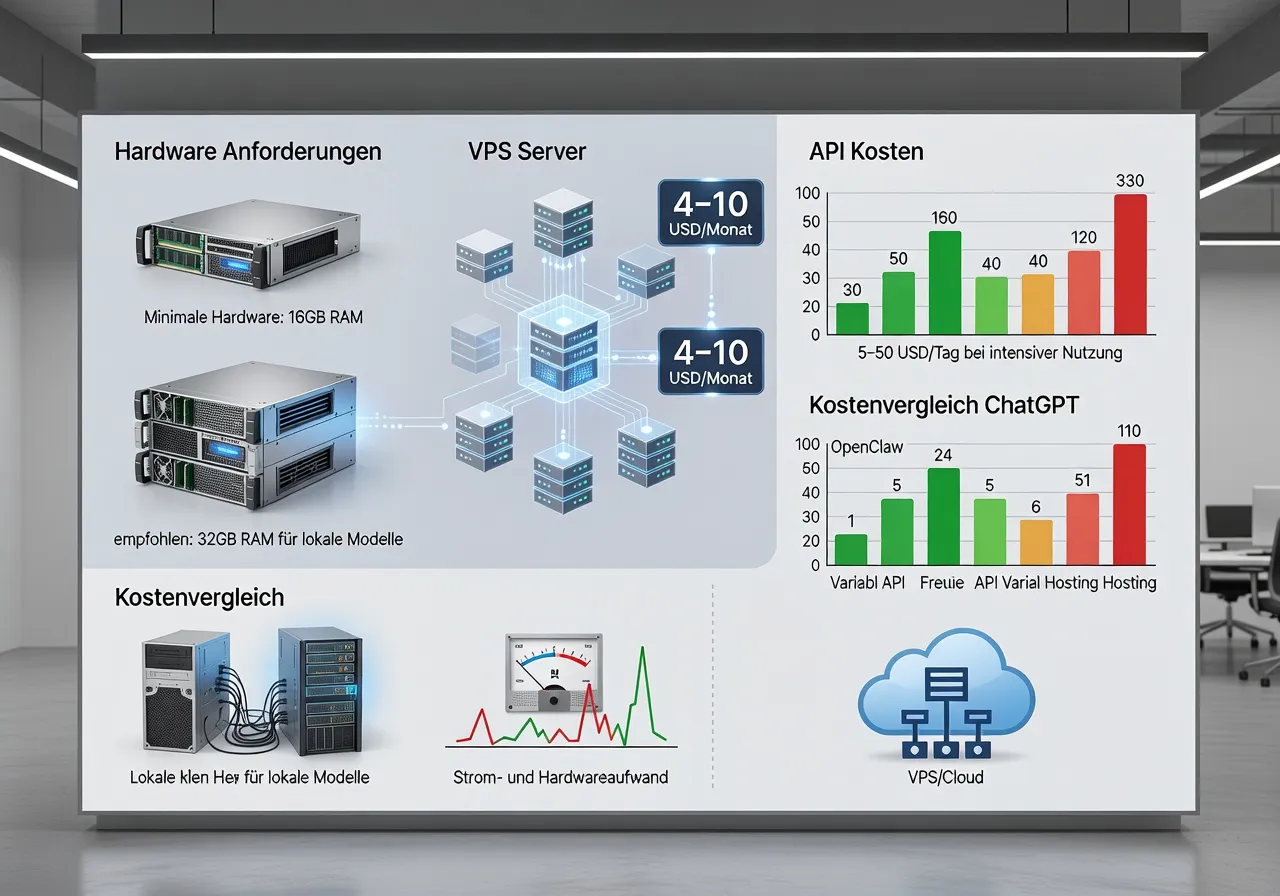

OpenClaw selbst ist kostenlos. Die Rechnung entsteht erst durch Hardware Anforderungen, Strom, VPS Server/Cloud und optionale API Kosten. In meiner Praxis gilt: Je mehr ich lokal ausführe, desto weniger zahle ich pro Anfrage – aber desto mehr zahle ich für Setup und Betrieb.

„OpenClaw ist vollständig kostenlos und open-source ohne Abonnements. Nutzer zahlen primär für Hardware und API Kosten.“

Hardware Anforderungen: lokal vs. leichtgewichtig

- Minimum: 16 GB RAM (Agent-Logik, Tools, kleinere lokale Modelle/Workflows).

- Empfohlen: 32 GB RAM, wenn ich lokale Modelle stabil nutzen will (z.B. via Ollama), um API-Kosten zu drücken.

Lokale Modelle können null API-Kosten bedeuten, erhöhen aber Hardware- und Stromaufwand. Dazu kommt Wartung (Updates, Logs, Backups) und Security-Hardening als „versteckte Kosten“.

VPS Server: günstiger Einstieg, klare Fixkosten

Für ein dauerhaft erreichbares Setup starte ich oft mit einem VPS Server ab ca. 4–10 USD/Monat. Das reicht für Orchestrierung, Webhooks und Integrationen (Telegram/Discord), während das Modell je nach Strategie lokal oder per API läuft.

API Kosten: der variable Block

Bei intensiver Nutzung liegen API Kosten typischerweise bei 5–50 USD/Tag (abhängig von Modell, Kontextlänge, Tool-Aufrufen). Das ist der Hebel, der Budgets sprengt oder spart.

Kostenvergleich ChatGPT: Team-Rechnung

| Option | Typische Kosten | Hinweis |

|---|---|---|

| Claude Pro | ~20 USD/Monat | Einzelplatz, wenig Admin |

| Enterprise-AI | 50–200 USD/User | Compliance & Support |

| OpenClaw Selbsthosting | VPS 4–10 USD/Monat + API 5–50 USD/Tag | Know-how nötig |

Für Teams ist der Kostenvergleich ChatGPT besonders spannend: Für ein 10‑Personen‑Team werden bei gutem Selbsthosting Einsparungen von ~25.000–40.000 USD/Jahr gegenüber ChatGPT Team genannt – wenn Betrieb und Sicherheit intern sauber gelöst sind.

4) Governance, Recht & eine pro‑menschliche Kontrollsicht

Cease-and-Desist: Rechtliche Risiken sind real

Der Wendepunkt kam für mich mit der juristischen Intervention von Anthropic gegen Peter Steinberger: Die Cease-and-Desist-Anweisung und das Verbot, ClawdBot weiter zu nutzen, haben klar gezeigt, dass Open-Source Software im Agentenmarkt nicht nur eine Technikfrage ist, sondern auch eine Lizenz‑, Marken‑ und Haftungsfrage. Solche Governance‑Risiken können Innovation bremsen oder verschieben – im Fall OpenClaw sogar in Richtung eines neuen Trägers.

OpenAI, Stiftung und das Spannungsfeld „OpenClaw kostenlos“

Mit Steinbergers Wechsel zu OpenAI am 17. Februar 2026 und der Ankündigung, OpenClaw in eine unabhängige Stiftung zu überführen, entsteht ein neues Spannungsfeld: Viele wollen OpenClaw kostenlos nutzen und erwarten echte Offenheit. Gleichzeitig wächst der Druck auf institutionelle Kontrolle – auch wegen OpenAI‑Debatten wie Werbeintegration, Pentagon‑Vertrag und internen Sicherheitsturbulenzen.

Sam Altman: „Wir wollen die nächste Generation personalisierter Agents bauen.“

Ich sehe die Stiftungsidee als Chance, Offenheit zu sichern – aber nur, wenn sie strikte Audit‑ und Governance‑Regeln hat. Sonst bleibt „open“ am Ende nur ein Marketingwort.

Meine Position: Human-friendly control statt volle AI Agent Autonomy

Ich widerspreche der Idee, Agenten völlig autonom laufen zu lassen. Gerade wenn Agent Skills Toolzugriff, Code‑Ausführung und Messaging verbinden, braucht es einen klaren menschlichen Eingriffspfad. Harrison Chase trifft den Kern, wenn er sagt:

Harrison Chase: „Der offene, manchmal kompromisslose Entwicklungsstil hat entscheidend zur Viralität beigetragen.“

- Human-in-the-Loop für riskante Aktionen (Zahlungen, Deployments, Datenexport).

- Signoff-Policies: Freigaben pro Skill und pro Zielsystem.

- Rückrufmechanismus („Kill Switch“) mit sofortigem Token‑ und Rechteentzug.

- Open-Source Audit Trails: nachvollziehbare Logs, reproduzierbare Runs, klare Verantwortlichkeiten.

5) Praxis: Empfehlungen für IT‑Entscheider und Entwickler

Entscheidungspfad: Selbst gehostet vs. Cloud

Wenn ich OpenClaw bewerte, starte ich mit einer einfachen Frage: Wollen wir Kontrolle oder Bequemlichkeit? Selbst gehostet lohnt sich vor allem, wenn im Team Technisches Wissen für Setup, Updates und Monitoring vorhanden ist. Für einen ersten Betrieb reichen 16GB RAM (Minimum), ich plane aber lieber mit 32GB RAM, weil Memory, Skills und Tooling schnell wachsen. Cloud-Abos sind oft schneller startklar, aber weniger transparent bei Datenflüssen und Limits.

| Posten | Richtwert |

|---|---|

| RAM lokal | 16–32GB (32GB optimal) |

| VPS | 4–10 USD/Monat |

| API‑Budget | 5–50 USD/Tag |

Wichtig: Kostenersparnis Team entsteht nur, wenn Wartung und Security nicht „nebenbei“ laufen. Sonst schmälern Sicherheitsaufwand und Betrieb die Einsparungen — Planung ist entscheidend.

Sicherheitscheckliste für Agenten im Alltag

- Sandboxen für Code-Ausführung, getrennte Secrets, keine Default-Adminrechte

- API‑Limitierung (Rate Limits, Budget Caps, Allowlists für Tools)

- Audit‑Logs für Prompts, Tool-Calls, File-Zugriffe und Memory-Änderungen

- Zugriffskontrollen (RBAC, getrennte Rollen für Dev/Prod, MFA)

- Regelmäßige Pen‑Tests und Red-Teaming gegen Prompt-Injection

Ich sehe die größten Produktivitätsgewinne dann, wenn menschliche Steuerungsprozesse fest eingebaut sind: Freigaben, Review-Schritte und klare Stop-Kriterien.

Adopt-or-Build: Proof‑of‑Concept zuerst

Mein Standardweg: OpenClaw lokal als Proof‑of‑Concept aufsetzen, dann gezielt erweitern. Ich teste früh ClawdHub‑Skills und binde lokale LLMs via ollama an, um Daten im Haus zu halten und Kosten zu kontrollieren.

Harrison Chase: „Coding Agents sind im Kern General‑Purpose‑Agents, weil ihre programmierbaren Kompetenzen weit über klassische UIs hinausreichen.“

6) Wild Cards: Szenarien, Analogien & persönliche Abschweifungen

Wenn AI Agent Autonomy im Support „zu gut“ funktioniert

Wild Cards helfen mir, abstrakte Risiken greifbar zu machen. Ich stelle mir einen IT-Support vor, in dem ein Agent die Ticketbearbeitung automatisiert: Er liest Logs, priorisiert, antwortet, eskaliert. Dann passiert das eine Ticket, das er falsch einordnet: Statt „P2“ wird es „P0“, Pager gehen los, Teams stoppen Releases. Eine falsche Eskalation kann einen Workflow für Tage stören; die Kosten sind schwer zu beziffern, aber der Vertrauensverlust ist sofort da. Die Kernfrage ist nicht, ob Fehler passieren, sondern wie der menschliche Rückruf greift: Wer darf den Agenten stoppen, welche Aktionen sind reversibel, und wer haftet, wenn der Agent bereits Systeme verändert hat? Genau hier braucht Open-Source AI klare Design-Standards, Audit-Trails und Verantwortlichkeitsketten, die auch im Stress halten.

„The claw is the law“ – die Klaue als Gesetzgeber

Als Analogie sehe ich OpenClaw wie einen aggressiven Gesetzgeber der Entwicklerkultur: Was schnell, kostenlos und offen ist, setzt Normen, bevor Policies nachziehen. OpenClaw kostenlos klingt nach Freiheit, kann aber auch bedeuten, dass Sicherheitsregeln als „optional“ gelten. In einer Community, die Viralität über Vorsicht stellt, wird das Tooling selbst zur Verfassung: Wer auditiert? Wer misst „sichere Nützlichkeit“? Und wer entscheidet, welche Skills überhaupt ausgeliefert werden dürfen?

Mein „Mutter-Test“ und die echte Hürde

Ich habe einen Agenten meiner (fiktionalen) Mutter eine Einkaufsliste erklären lassen: nicht als Prompt-Show, sondern als Dialog mit Rückfragen, Alternativen und einem „Stopp“-Knopf. Da wurde mir klar: Bedienbarkeit ist der Engpass. „Even my mother“ ist kein Witz, sondern Adoption. Marktdynamik sieht man an Rekorden wie über 1 Mio Downloads der OpenAI Codex-App in einer Woche. Wenn OpenClaw diese Einfachheit mit Kontrolle verbindet, wird es groß.

Sam Altman: „Die nächste Generation personalisierter Agents wird unsere Interaktion mit Technik neu definieren.“

Mein Fazit: Offenheit, Tempo und AI Agent Autonomy sind Chance und Risiko zugleich. Entscheidend ist, ob wir Freiheit so bauen, dass Menschen sie jederzeit sicher zurückholen können.